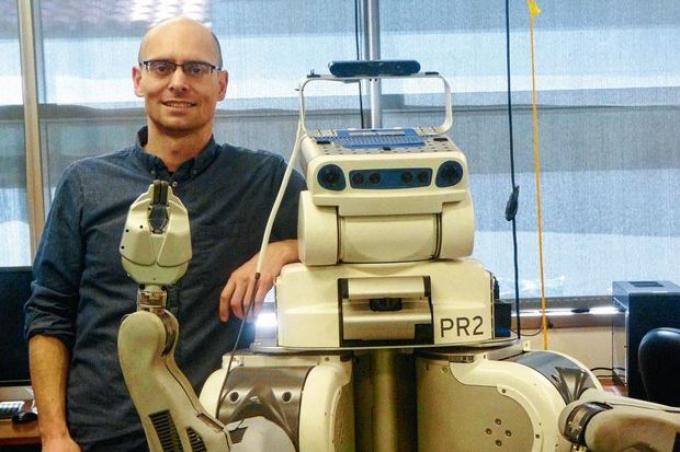

Le célèbre chercheur flamand Pieter Abbeel est une figure emblématique du paysage de l’intelligence artificielle. Data News l’a rencontré dans son labo de Berkeley en Californie.

” Attendez, je vais changer la position de sa main “, explique le professeur Pieter Abbeel alors qu’il règle le bras du robot BRETT (Berkeley Robot for the Elimination of Tedious Tasks) dans son laboratoire d’intelligence artificielle (IA) à l’université de Berkeley.

En 2010, Abbeel et son équipe avaient réussi avec BRETT une véritable percée dans le monde des robots et de l’IA en apprenant à un robot à plier des serviettes. No big deal, diriez-vous, mais détrompez-vous. ” Les serviettes ne sont pas rigides “, explique Abbeel, ce qui signifie qu’à chaque fois après une lessive, la serviette se positionne différemment. Dès lors, un robot préprogrammé ne convient pas puisqu’il a besoin de coordonnées exactes pour pouvoir procéder au pliage. ” Nous avons fait en sorte que le robot reconnaisse les coins de la serviette puis la plie ensuite chaque fois de la même manière. ” Et BRETT a réussi l’opération de manière fiable : 50 des 50 serviettes qui lui ont été présentées ont été correctement pliées, même s’il lui a fallu 20 minutes par serviette. ” Si nous demandions à BRETT de refaire l’opération aujourd’hui, il ne mettrait sans doute qu’une minute “, explique encore Abbeel.

Il est très difficile de comprendre le cerveau et sa manière de fonctionner.

Ces dernières années, le monde de l’IA a connu une accélération spectaculaire à laquelle Abbeel a largement contribué. Il a quitté Brasschatt en 2000 pour la Californie afin d’y suivre un mastère, puis une recherche à la Stanford University. A l’époque, il avait imaginé un hélicoptère automatique capable notamment de voler à l’envers et commandé par un pilote humain. En 2008, il est nommé professeur à Berkeley, mais en a vite assez des multiples recherches qu’il doit réaliser. Dès lors, il utilise l’IA pour automatiser certaines tâches, ce qui l’incite à créer sa propre société, GradeScope. Il travaille par ailleurs durant 2 ans chez OpenAI, un organisme de recherche fondé par Elon Musk spécialisé en ‘IA sécurisée’. Et fin 2017, il part pour fonder sa propre entreprise, Embodied Intelligence, dans le but d’apprendre des tâches à des robots grâce à la réalité virtuelle. Nous avons rencontré Abbeel dans son labo de Berkeley – les bâtiments d’Embodied Intelligence sont strictement interdits aux personnes étrangères en raison du caractère extrêmement pointu des recherches qui y sont menées.

Comment s’est développée votre passion pour l’intelligence artificielle ?

PIETER ABBEEL : J’ai toujours été fasciné par l’intelligence et par la manière dont l’homme cherche à résoudre les problèmes. Mais il est très difficile de comprendre le cerveau et sa manière de fonctionner. Des recherches sont certes menées et des progrès sont réalisés, mais aucune avance fondamentale n’a encore été enregistrée. Il me semblait que l’on pourrait avancer plus vite si l’on mettait au point notre propre solution. En construisant son propre système apprenant, on pourrait sans doute mieux comprendre la manière dont l’homme apprend plutôt qu’en regardant le cerveau à travers un microscope.

Qu’avez-vous appris ces 18 dernières années sur le mode d’apprentissage de l’homme ?

PIETER ABBEEL : Je ne sais pas si nous avons appris quelque chose de nouveau sur l’apprentissage, mais bien sur la façon dont les ordinateurs apprennent. Et cela nous permet de comprendre le processus d’apprentissage global. Mon labo se concentre surtout sur le reinforcementlearning où un robot apprend par essais et erreurs en lui donnant un objectif et une série de récompenses. Une voiture autonome reçoit par exemple un point positif si elle atteint sa destination finale, un point négatif si elle commet une infraction au code de la route et un point très négatif si elle commet un accident. Le système s’optimise ensuite de lui-même sur base de ce système de récompenses. Il s’agit fondamentalement d’une approche différente du supervised learning où l’on alimente le système avec de très nombreuses données qui sont ensuite annotées et couplées à certains résultats. La véritable IA est une technique qui a un objectif réel et essaie de l’atteindre en apprenant d’elle-même.

Vous pouvez modifier vos choix à tout moment en cliquant sur « Paramètres des cookies » en bas du site.

Marcher en essayant

Abbeel sort son ordinateur portable et montre un film d’animation présentant un robot couché sur le dos sur un sol quadrillé noir/blanc. Il s’agit d’une simulation d’un robot qui apprend à marcher. ” En temps normal, il faut programmer toutes sortes de lois naturelles dans l’ordinateur, alors qu’un enfant qui commence à marcher ne connaît rien de Newton et de la gravitation. Il apprend simplement à marcher en essayant et réessayant. ” Abbeel adopte le même principe avec le robot de l’animation. ” Nous avons donné à l’ordinateur un objectif : courir le plus vite possible en direction du nord, explique Abbeel, avec quelques paramètres sur son corps et le centre gravitationnel. Ensuite, nous avons laissé l’ordinateur essayer de marcher. ” Sur l’écran, on voit l’ordinateur continuellement tomber et se relever, mais après un millier d’itérations environ, il se met à marcher sans problème. L’ordinateur (de type neuronal) exécute en fait chaque fois un calcul aléatoire et s’il constate que le résultat est un peu meilleur, il s’adapte lors du calcul suivant jusqu’à atteindre le résultat final. ” La beauté du système, c’est qu’une fois que l’ordinateur a calculé la manière de marcher correctement, il est possible de réutiliser le code dans un robot ayant un aspect extérieur totalement différent “, ajoute-t-il en présentant un film d’animation avec un robot ressemblant à une araignée.

Vous pouvez modifier vos choix à tout moment en cliquant sur « Paramètres des cookies » en bas du site.

Les simulations sont utilisées parce qu’elles permettent d’aller beaucoup plus vite qu’avec un robot dans le monde physique. En effet, un ordinateur/robot est capable d’exécuter beaucoup plus rapidement les calculs nécessaires que s’il opérait dans la réalité. Si chaque fois qu’il tombe, l’ordinateur doit se relever, cela lui prend à chaque fois beaucoup plus de temps que dans un environnement simulé. Mais le même principe d’apprentissage s’applique aussi aux robots physiques (non simulés). Pour preuve, Abbeel nous présente un film où BRETT essaie de glisser un bloc de couleur dans une case – le même jeu que celui auquel jouent les enfants dans leur apprentissage. Et un film où BRETT pend un cintre. Et où BRETT met un bouchon sur une bouteille. ” Ce qui est intéressant, c’est que nous avons développé une méthode d’apprentissage très générique qui peut être appliquée dans un large éventail de situations. ”

Vous pouvez modifier vos choix à tout moment en cliquant sur « Paramètres des cookies » en bas du site.

Quel est le rapport entre vos travaux et votre nouvelle société Embodied Intelligence ?

PIETER ABBEEL : Toute l’activité est liée aux travaux que nous faisons ici en labo [Abbeel nous présente un nouveau film]. L’un de mes étudiants, Tienhao Zhang, cherche à l’aide de lunettes de réalité virtuelle et de contrôleurs à apprendre à BRETT à placer un bloc dans la bonne case. L’intérêt d’une telle approche est d’offrir une combinaison parfaite entre la perception du robot et celle de l’homme [via les lunettes RV, Tienhao voit exactement la même chose que le robot, NDLR]. C’est comme si l’homme était littéralement le cerveau du robot. Le robot reçoit donc le signal parfait pour l’apprentissage. Le reinforcement learning est intéressant dans la mesure où il permet d’apprendre des compétences dès le début, ce qui explique d’ailleurs que ce soit si lent. Mais ce que nous faisons ici avec les outils de RV, c’est de l’imitation learning où le robot apprend 1-sur-1 de l’homme ce qu’il doit faire. Avec cette technique, il est possible d’apprendre à un robot en 30 minutes une nouvelle compétence, sachant qu’il ne faut pas être un expert en robotique pour y arriver. Nous estimons qu’il s’agit là d’une approche promue à un bel avenir.

Nous construisons un système intelligent capable de combattre le cancer et de lutter contre le réchauffement climatique, mais la question est : le fera-t-il jamais ? Un robot ne sera jamais victime d’un cancer.

Expliquez-vous.

PIETER ABBEEL : Toute l’activité est liée aux travaux que nous faisons ici en labo [Abbeel nous présente un nouveau film]. L’un de mes étudiants, Tienhao Zhang, cherche à l’aide de lunettes de réalité virtuelle et de contrôleurs à apprendre à BRETT à placer un bloc dans la bonne case. L’intérêt d’une telle approche est d’offrir une combinaison parfaite entre la perception du robot et celle de l’homme [via les lunettes RV, Tienhao voit exactement la même chose que le robot, NDLR]. C’est comme si l’homme était littéralement le cerveau du robot. Le robot reçoit donc le signal parfait pour l’apprentissage. Le reinforcement learning est intéressant dans la mesure où il permet d’apprendre des compétences dès le début, ce qui explique d’ailleurs que ce soit si lent. Mais ce que nous faisons ici avec les outils de RV, c’est de l’imitation learning où le robot apprend 1-sur-1 de l’homme ce qu’il doit faire. Avec cette technique, il est possible d’apprendre à un robot en 30 minutes une nouvelle compétence, sachant qu’il ne faut pas être un expert en robotique pour y arriver. Nous estimons qu’il s’agit là d’une approche promue à un bel avenir.

Les gens ont-ils raison de craindre pour leur emploi ?

PIETER ABBEEL : Le travail que font les gens va disparaître. Le travail qui est aujourd’hui réalisé par 10 personnes pourra demain être effectué par une seule personne avec 10 aides-robots. Il faut aussi savoir que les robots pourront demain exécuter des tâches pénibles pour l’homme, comme soulever des charges lourdes ou manipuler des matières dangereuses. Mais la question est évidemment de savoir ce que vont faire ces 9 personnes qui se retrouveront sans travail. Dans l’ensemble, je pense que les gens trouveront toujours quelque chose à faire. Autrefois, l’homme n’achetait que de la nourriture. Aujourd’hui, il veut aussi un téléphone ou un appareil photo. En outre, si les produits sont fabriqués 10 fois plus efficacement grâce aux robots, la prospérité devrait en principe, dans un monde idéal, être multipliée par 10 également. Pas tellement au niveau du montant sur notre compte en banque, mais ces produits achetés devraient être 10 fois moins chers.

Les gens craignent également un monde dystrophique, avec des robots qui prennent le contrôle du monde. Cette crainte est-elle fondée ?

PIETER ABBEEL : Nous construisons maintenant quelque chose qui sera plus intelligent que nous et que nous ne pourrons alors plus contrôler et prédire. Si nous développons un tel système intelligent, c’est pour vaincre le cancer, lutter contre le réchauffement climatique, découvrir de nouveaux matériaux et arriver sur Mars. Mais la question est : le fera-t-il jamais ? Pourquoi nous lancer dans de tels défis ? Un robot ne sera jamais victime d’un cancer. Il y a 2 manières d’aborder la question. La première est de veiller à ce que le robot apprenne de l’homme, y compris ce qui touche l’homme, et à l’optimiser afin d’y arriver. La seconde consiste à ne pas construire l’IA comme une entité à part, mais comme une extension du cerveau humain.

Ne considérez-vous pas qu’il s’agit d’une approche trop restrictive ?

PIETER ABBEEL : Sur le plan évolutionnaire, l’homme n’avait pas de néocortex qui permettait notamment d’observer, de raisonner et de se mouvoir. Pourtant, personne ne considère ce néocortex pour une sorte d’IA qui vit dans le cerveau. Or les gens le font déjà : ils portent des lunettes ou des prothèses pour étendre leurs capacités. L’extension du cerveau à l’aide d’un élément artificiel est certes quelque chose de différent, mais s’appuie sur le même principe.

L’IA est un outil pouvant être utilisé à des fins utiles ou mauvaises.

PIETER ABBEEL : C’est exact.

Des garanties peuvent-elles être prévues pour éviter que l’IA ne tombe dans une sorte de spirale négative ?

PIETER ABBEEL : Il ne devrait pas être trop difficile de trouver des définitions de ce qui est bien et pas bien. Et ce n’est pas très différent de ce qui est bien ou pas bien pour l’individu. Les gens ont lancé des fake news en ligne. Demain, l’IA pourra en lancer 10 fois plus. Nous n’avons pas encore véritablement trouvé la manière de limiter les fake news des hommes, alors comment y parvenir pour les robots ?

Peut-on apprendre à un robot à être bon ?

PIETER ABBEEL : Pourquoi pas ? Mais la question est alors : si c’est possible, quelqu’un d’autre pourra-t-il lui apprendre le contraire ?

A nouveau, ne s’agit-il pas d’une approche trop restrictive ?

PIETER ABBEEL : Il s’agit certainement d’une question dont il faut prendre conscience. Nous devons être prudents et réfléchir à la manière dont ce type de technologie peut être utilisé et où cela nous mènera.