Facebook a étendu son algorithme autodidacte en vue de repérer les utilisateurs suicidaires. Le réseau social va à présent mettre en oeuvre son système de détection partout au monde, sauf dans les pays européens en raison des règles européennes plus strictes en matière de respect de la vie privée.

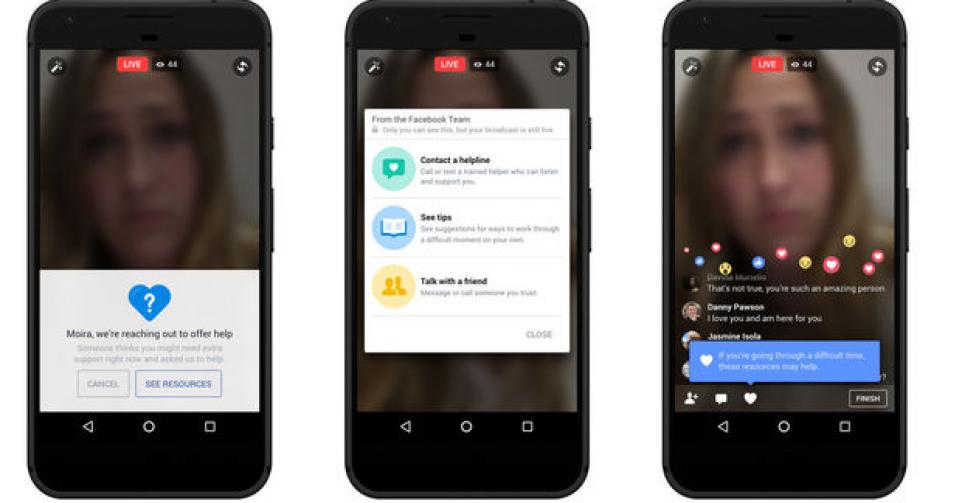

Depuis quelques années, tout le monde peut insérer des messages à caractère suicidaire sur Facebook, après quoi ces messages sont transférés à un gestionnaire, qui peut éventuellement activer l’assistance nécessaire. Dans ce but, Facebook collabore avec des organisations spécialisées dans la prévention du suicide.

Pour détecter encore plus rapidement ce genre de cri de détresse, Facebook a introduit en mars de cette année une technologie apprenant par elle-même. Il s’agit en l’occurrence d’un algorithme autodidacte, qui a appris à identifier des modèles dans des données existantes et qui pourra désormais être utilisé aussi pour détecter ces modèles dans de nouvelles données. Ces données peuvent être des messages inquiétants, des réactions soucieuses à ceux-ci, voire des appels à l’aide sous la forme de vidéos en direct. Plus l’algorithme de détection s’appliquera, plus il deviendra intelligent. “A l’avenir, l’intelligence artificielle nous aidera à reconnaître également les nuances linguistiques plus subtiles et à identifier les tendances suicidaires, mais aussi le harcèlement”, écrit le CEO de Facebook, Mark Zuckerberg.

Facebook utilisera aussi cette intelligence artificielle lors du tri des messages inquiétants, afin que son équipe de collaborateurs sache immédiatement quels sont les plus urgents. L’équipe qui doit juger les appels à l’aide détectés ou rapportés, sera en outre étoffée.

Confidentialité

Ces derniers mois, ce moyen de prévention du suicide a déjà été testé aux Etats-Unis. A présent, la technologie va être étendue au reste du monde, à l’exception de l’Union européenne. L’algorithme y enfreindrait en effet la réglementation GDPR, qui entrera en vigueur en mai de l’année prochaine. C’est pour cette raison que Facebook avait précédemment déjà désactivé aussi la reconnaissance automatique des visages dans les pays européens.