Des chercheurs américains ont découvert que les voitures autonomes peuvent être facilement ‘piratées’ en collant des stickers sur des panneaux routiers. Ce qui semble être une subtile adaptation pour l’oeil humain, peut suffire pour que la voiture autonome ignore un signal ‘stop’ par exemple, avec toutes les conséquences que cela peut avoir.

Au fur et à mesure que les voitures sont davantage connectées en ligne et que la voiture autonome poursuit sa marche en avant, le risque que des pirates manipulent le software embarqué augmente. Mais une autre forme possible de piratage est généralement négligée, à savoir que l’environnement de la voiture peut lui aussi être ‘piraté’. En effectuant de légères adaptations aux panneaux de signalisation, il serait possible en effet de berner sérieusement le logiciel de ce genre de voiture.

Les systèmes AI (artificiellement intelligents) considèrent les choses environnantes d’une autre manière que nous, les humains. Les capteurs des voitures autonomes fonctionnent certes plus ou moins comme nos yeux, mais le logiciel qui doit interpréter les images captées, fonctionne lui d’une toute autre façon que notre cerveau.

Le logiciel ‘intelligent’ dans la panade!

On sait depuis assez longtemps déjà que des adaptations minimes d’images peuvent faire en sorte que les systèmes AI interprètent celles-ci d’une manière fondamentalement différente. En recouvrant par exemple l’illustration d’un panda d’une fine couche numérique, il est possible de faire croire à ce genre de système qu’il s’agit d’un gibbon.

Des chercheurs de Google Brain, le centre de recherche AI de Google, ont affirmé que ce type de manipulation est aussi possible dans le monde réel. En imprimant simplement des images manipulées et en les photographiant avec un smartphone, ils ont réussi à tromper des systèmes AI.

Dans la communauté AI, il y a pour l’instant un solide débat à propos du risque que les panneaux routiers fassent eux aussi l’objet de manipulations. Est-il possible de berner les voitures autonomes en modifiant légèrement ces panneaux? Le mois dernier, des chercheurs de l’université d’Illinois ont publié un rapport, dont la conclusion était rassurante: pour ce qui est des voitures, nous n’avons aucun souci à nous faire. ‘Comme les capteurs voient les signaux routiers sous différentes perspectives et en plusieurs tailles, ils ne peuvent se tromper’, pouvait-on lire.

Trompé par un chat

Cette conclusion souleva directement pas mal de critiques d’autres experts en la matière. OpenAI notamment, l’organisation non marchande d’Elon Musk qui effectue des recherches sur l’intelligence artificielle, mit la conclusion en doute. Sur le blog d’OpenAI, on peut voir comment une photo apparemment anodine d’un chat peut être manipulée de telle sorte que l’algorithme croit qu’il s’agit d’un ordinateur desktop plutôt que d’un chat. Ce qui est important ici, c’est qu’ils sont parvenus à réaliser une variante à l’échelle de cette manipulation. Cela signifie que quelle que soit la perspective de vision du chat par le logiciel intelligent, ce dernier est toujours trompé.

Les chercheurs d’OpenAI ont de ce fait réfuté la conclusion, selon laquelle les capteurs embarqués seraient insensibles à ce genre de piratage du simple fait qu’ils verraient les images sous différents angles. Du moins en théorie car il n’était pas encore démontré que ces manipulations fussent suffisantes pour perturber aussi les voitures autonomes dans le monde réel.

Panneaux routiers vandalisés

Voilà pourquoi des scientifiques américains ont récemment effectué une nouvelle expérience, où ils ont tenté de berner la reconnaissance de modèles par les voitures autonomes de trois manières différentes.

Les chercheurs ont d’abord entièrement recouvert un signal ‘stop’ par une version imprimée dans laquelle de très légères modifications avaient été réalisées. Pour l’oeil humain, il était difficile de distinguer à distance le faux signal d’un vrai, mais les voitures autonomes, elles, ont dans cent pour cent des tests identifié le signal manipulé comme un panneau de limitation de vitesse.

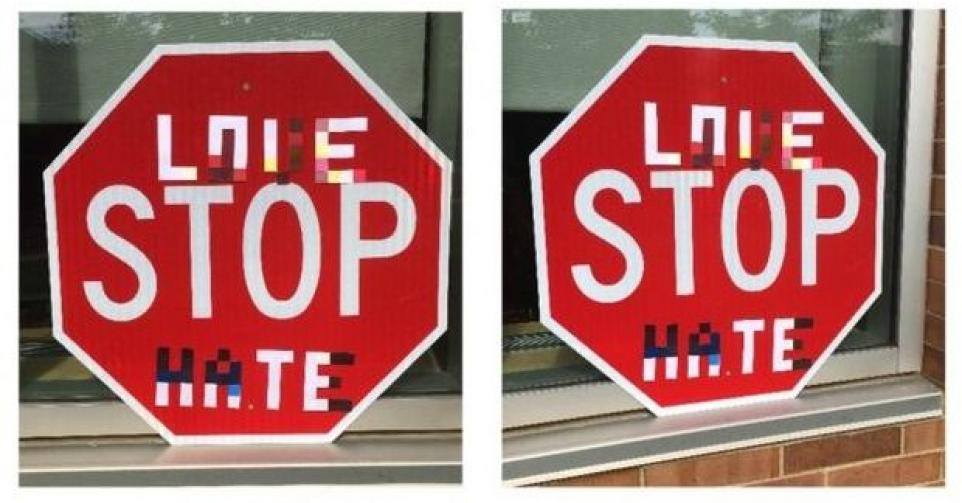

Une deuxième méthode consista à ‘vandaliser’ un signal ‘stop’. Les chercheurs y ont collé des stickers portant les termes ‘love’ et ‘hate’ en lettres graffiti. Cette manipulation berna le logiciel des voitures autonomes dans deux cas sur trois.

Enfin, ils lancèrent aussi une ‘attaque d’art abstrait’ contre le signal: au moyen de plusieurs stickers étroits placés en des endroits stratégiques, ils ont réussi à tromper toutes les voitures autonomes.

Même si le système AI avait à sa disposition pour chacune des expériences susmentionnées plusieurs images prises à différentes distances et sous diverses perspectives, il se trompa très régulièrement. Pour cela, les chercheurs ont simplement eu besoin d’un appareil photo et d’une imprimante couleur. Toute personne mal intentionnée pourrait donc facilement perturber les véhicules autonomes, avec toutes les conséquences que cela suppose. La condition est bien entendu que le pirate ait accès à l’algorithme du logiciel embarqué, afin qu’il sache quelles adaptations il doit apporter exactement.

Plusieurs nouveaux modèles de voiture sont d’ores et déjà équipés d’un logiciel capable de reconnaître les panneaux routiers et ce, même s’il n’y a encore aucun véhicule qui soit programmé pour y réagir effectivement. Ce type de logiciel sera à coup sûr de plus en plus présent au cours des années à venir. Le piratage numérique de l’environnement deviendra alors un problème de sécurité dont les constructeurs ont tout intérêt à tenir compte dès aujourd’hui.