De plus en plus de marques technologiques, dont à présent aussi Apple, selon l’agence Bloomberg, intègrent une fonction de traduction dans leurs écouteurs. Il n’empêche que le rêve caressé depuis longtemps déjà d’un traducteur universel, est encore et toujours bien loin de nous: le langage – surtout dans sa forme parlée – est en effet provisoirement encore trop insaisissable pour être suffisamment capté par l’intelligence artificielle.

Apple, comme le prétend du moins l’agence de presse professionnelle Bloomberg sur base de sources anonymes, planche sur une technologie de traduction à intégrer à ses AirPods: lorsque quelqu’un s’adressera à celui/celle qui les portera dans une langue étrangère, les paroles prononcées seront automatiquement traduites dans la langue parlée par le/la propriétaire des écouteurs. Cette nouvelle fonctionnalité serait introduite avec iOS 19 ultérieurement cette année.

Le fabricant américain sort ainsi, comme toujours, du bois avec une longueur de retard sur d’autres marques technologiques qui ont depuis quelque temps déjà intégré un traducteur intelligent artificiel dans leurs écouteurs. Google y était même parvenue dès 2017 dans ses Pixel Buds, alors que Xiaomi incorpore quant à elle une technologie de traduction instantanée dans ses Buds 5 Pro, tout comme Samsung dans ses Buds 3 Pro. Et des fabricants spécialisés tels que Timekettle et Vasco misent en outre sur leur propre technologique de traduction qui serait, à les entendre évidemment, encore meilleure.

Traducteur universel

Dans le domaine de la science-fiction, on rêve depuis des décennies déjà d’une technologie capable de traduire simultanément les langues parlées dans le monde entier, voire dans de nombreux cas dans l’ensemble de l’univers. Dans la série de science-fiction comique The Hitchhiker’s Guide to the Galaxy, l’écrivain Douglas Adams fait exécuter ce travail de traduction par Babel Fish, un petit poisson extraterrestre que les utilisateurs insèrent dans leur oreille, et qui se nourrit ensuite des ondes cérébrales des personnes environnantes et traduit ainsi leur langue dans celle de son porteur.

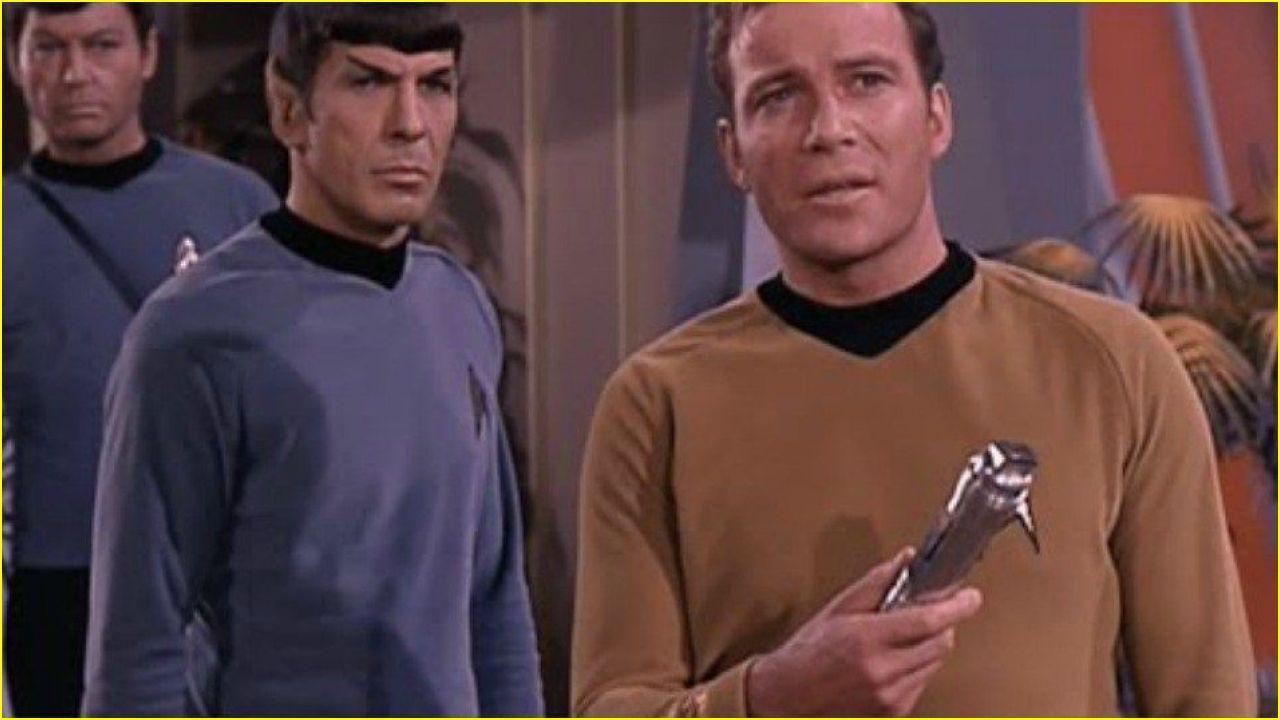

Peut-être encore plus connu parmi les adeptes de science-fiction: l’universal translator dans la série télévisée Star Trek: à l’époque de l’ancienne série, Captain Kirk devait utiliser dans ce but un objet en forme de tige, alors que dans The Next Generation, la technologie de traduction était directement intégrée dans le communicator que chaque membre de l’équipage portait sur la poitrine.

Long parcours

Ce rêve d’amener le traducteur universel vers la technologie grand public actuelle, existe depuis une décennie au moins, et ladite technologie a déjà accompli un long parcours. Mais même après la percée cruciale des Large Language Models (LLM) en 2022, on n’y est pas encore, et de loin. Les tests à l’échelle mondiale des écouteurs décrits ci-avant intégrant la fonction de traduction sont largement positifs certes, mais ils ne font que renforcer ce que des essais technologiques révèlent: mettre en regard les plus et les moins du produit actuel, tout en ne répondant que rarement à la question de savoir si la technologie est véritablement prête pour une utilisation quotidienne.

Or la réponse, comme il apparaît en lisant entre les lignes les résultats obtenus, serait essentiellement négative: dans le cadre d’un test des tout récents écouteurs-traducteurs du fabricant spécialisé Timekettle, lors du salon IFA en septembre 2024, TechRadar écrivait ceci: ‘On aimerait voir sortir les traductions plus rapidement, pour obtenir un flux plus naturel.” Et Wired, dans un test quelque peu plus récent du Vasco Translator E1, tenait ces propos: “Comme avec tous les outils de traduction existants, il convient de parler assez lentement, de marquer une pause toutes les deux lignes et d’être aussi clair que possible dans la pronociation.”

Eliminer les lacunes

Pour percer vraiment, la technologie doit donc encore gommer pas mal de lacunes. Au cours des dernières années, les modèles de langage ont déjà connu une progression étonnante, mais traduire simultanément les communications verbales, c’est encore une autre paire de manches: à cette fin, la latence des écouteurs est encore trop importante (la plupart des tests évoquent un délai de 2,5 secondes pour interpréter le langage vocal) et dans la plupart des cas, il y a encore aussi un smartphone dans le processus. En outre, la précision fait encore défaut. Accents, dialectes, langage de la rue, jargon, présence de plus de deux interlocuteurs: toutes des choses qui font encore obstacle à une traduction précise.

Mais le seul véritable frein technologique se situe dans les modèles de langage sous-jacents, mais ici aussi, l’évolution progresse encore et toujours de manière accélérée. Des fabricants spécialisés éliminent petit à petit les obstacles connus. Timekettle, créée en 2016 dans le but de présenter un jour une technologie proche du Babel Fish de Douglas Adams, semble être actuellement en pole position. Babel OS, le logiciel que l’entreprise chinoise a récemment présenté, tente par exemple de gagner en vitesse et en précision via la segmentation: les phrases prononcées sont subdivisées, après quoi des algorithmes individuels se penchent de plus près sur le contenu de ces fragments de phrase. Timekettle expérimente aussi la technologie du clonage vocal, pour que les traductions que les écouteurs envoient dans l’oreille de celui/celle qui les porte, se rapprochent de la voix de celui/celle qui les prononce.

On sous-estime en outre la manière dont la technologie – avec tous les manquements actuels – surmonte depuis tout un temps déjà les barrières linguistiques. Un touriste un peu clairvoyant parvient par exemple à traduire depuis une bonne décennie déjà les panneaux signalétiques dans une langue étrangère via l’appareil photo de son smartphone: l’appli Google Translate y arrive. Sûr que Captain Kirk aimerait disposer de cette technologie dans plus de… deux cents ans.