Une voiture autonome doit sauver la vie d’un enfant aux dépens de celle d’un senior. Tel est le consensus que des chercheurs du MIT ont découvert après avoir présenté 40 millions de dilemmes moraux à des personnes dans le monde entier. Lorsqu’il est cependant question du sexe, du statut social ou de l’intégrité de la victime, les réponses semblent différer d’une culture à l’autre.

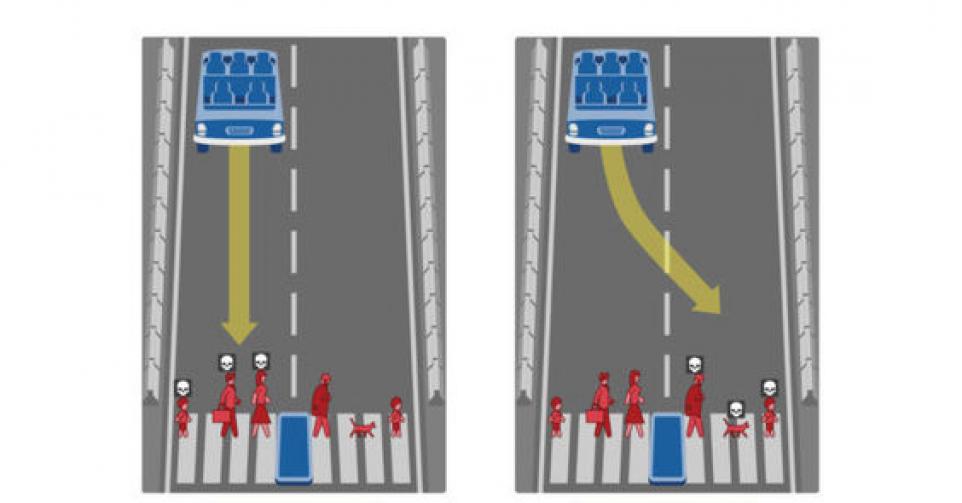

D’après les attentes, les voitures autonomes sauveront des millions de vies. Il y aura toutefois des situations de circulation dangereuses, où la voiture ne pourra pas sauver tout le monde. C’est à ce moment que des décisions complexes devront être prises quant à savoir qui épargner et qui renverser. La voiture devra-t-elle alors éviter un ado qui traverse soudainement la route et ce, aux dépens d’un passager plus âgé? Pourra-t-elle sacrifier la vie d’un SDF ou d’un chien et épargner ainsi une femme enceinte?

C’est à ce type de dilemmes éthiques que des philosophes moralistes réfléchissent depuis cinquante ans déjà. Il y a cinquante ans, le ‘dilemme du tramway’ était encore purement une expérience de pensée. A présent que des ingénieurs sont en train d’écrire les programmes des voitures autonomes, ce genre de considération morale aura aussi des effets dans la pratique. Il devient donc important que nous arrivions rapidement à un consensus commun.

Voilà précisément pourquoi des chercheurs du Massachusetts Institute of Technology (MIT) ont présenté au cours des deux dernières années des dilemmes de ce type à des millions de personnes dans 233 pays. Ils ont pour cela utilisé The Moral Machine, un quiz viral, où les personnes avaient treize fois le choix entre deux scénarios. Les chercheurs ont varié les victimes potentielles sur la base de neuf paramètres: passager ou piéton, homme ou femme, jeune ou vieux, athlétique ou obèse, statut social supérieur ou inférieur, personne ou animal. Certains des piétons respectaient scrupuleusement le code de la route, alors que d’autres ignoraient un feu rouge par exemple. La question de savoir si la voiture doit garder sa trajectoire ou doit effectuer une manoeuvre pour renverser d’autres victimes, joua aussi un rôle. De plus, le nombre de victimes possibles variait également.

Faites ici vous-même le test

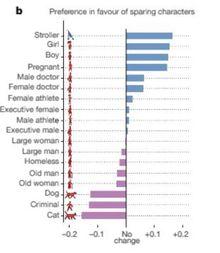

Les résultats de cette addition morale ont été publiés jeudi dans la revue Nature. Trois principes universels se sont dégagés clairement. La majorité des personnes est d’accord sur le fait que la voiture autonome doit toujours effectuer la manoeuvre requise pour faire le moins de victimes possible, qu’elle doit épargner la vie d’un enfant de préférence à celle d’un senior, et que la vie des humains doit être prioritaire sur celle des animaux.

Mais sur d’autres points, les avis étaient davantage divisés. Les réponses dépendaient aussi de la partie du monde, où le dilemme était présenté. Sur base de la géo-localisation, les chercheurs ont trouvé trois clusters, dans lesquels les participants avaient des considérations morales plus ou moins identiques: un cluster occidental (Europe et Etats-Unis), un cluster méridional (surtout Amérique latine) et un cluster oriental (Moyen-Orient et Asie).

Les chercheurs ont observé aussi une divergence systématique entre les cultures individualistes et collectivistes. Les membres de cultures collectivistes montraient par exemple davantage de respect pour les anciens et affichèrent donc une moins grande préférence à épargner les jeunes gens.

Dans les pays à forte disparité de revenus, on a plus souvent répondu que le statut social doit jouer un rôle (sauver plutôt un médecin qu’un sans-abri). Les chercheurs n’ont pas trouvé une explication claire sur ce plan: “Il est possible que cette disparité se répercute dans les préférences morales des personnes, mais l’inverse est aussi possible, à savoir que ces préférences morales étaient déjà présentes et ont exercé une influence sur l’inégalité dans tel ou tel pays.”

Les participants à l’enquête étaient partout d’accord pour dire qu’il fallait épargner plutôt les femmes que les hommes, mais dans les pays, où les perspectives de santé et de survie des femmes étaient meilleures, cette préférence était encore plus forte.

En outre, les chercheurs ont observé que les participants des pays riches étaient plus rapidement prêts à sacrifier les piétons qui ne respectaient pas le code de la route. “Les participants des pays plus pauvres avec des institutions plus faibles se sont montrés plus tolérants vis-à-vis des piétons qui traversaient la rue au mépris du code de la route, probablement parce que le non-respect de ce dernier y est moins durement réprimé”, spéculent les chercheurs.

Les chercheurs ne vont cependant pas jusqu’à prétendre que les gens doivent à présent avoir leur mot à dire quant à la façon dont les voitures autonomes sont programmées. “Les règles normatives doivent être élaborées par des experts, mais ceux-ci doivent être au courant de ce que pense le grand public et des réactions qu’ils peuvent en attendre.”

Ils renvoient à la seule liste de règles éthiques existant à ce jour à ce propos, et qui avait été édictée l’année dernière par la commission éthique allemande. Celle-ci stipule que lors d’un accident inévitable, la vie humaine doit avoir la priorité sur la vie animale – ce qui semble donc correspondre aux attentes sociales. Le rapport allemand indique aussi qu’il ne peut y avoir de différence sur base de l’âge, du sexe, des propriétés physiques ou mentales. Ici, il y a une contradiction avec le principe dominant, à savoir que les enfants doivent être épargnés aux dépens des seniors. Voilà qui démontre clairement combien il sera malaisé d’élaborer les règles que devront suivre les voitures autonomes. Il y a par conséquent encore du pain sur la planche pour les philosophes moralistes.