Microsoft développe les projets les plus fous en matière d’intelligence artificielle. Lors d’un événement consacré à l’IA à Londres, l’entreprise parle d’applications médicales, d’un monde meilleur et de l’ombre de HAL 9000.

“Nous traversons une époque passionnante pour l’IA”, déclare Harry Shum, executive vice president du département AI & Research de Microsoft. “La technologie nous offre d’innombrables opportunités, mais nous devons également réfléchir en détail à leur impact sur les emplois, la sécurité, l’éthique, etc.” Il donne tout de suite le ton de l’événement de Microsoft dédié à l’IA à Londres. La société n’est pas peu fière d’y montrer une série d’applications pratiques et de logiciels issus de ses recherches en matière d’IA. Il est frappant de constater que bon nombre de ces applications visent à “améliorer le monde”.

Il existe, par exemple, une Seeing AI, une application destinée aux aveugles, qui peut être téléchargée dans l’iOS App Store. L’application utilise la reconnaissance d’images de Microsoft pour décrire une photo. Si vous prenez, par exemple, l’image d’une dame souriante, l’application vous décrira oralement : “Une dame de 35 ans aux cheveux bruns qui semble heureuse.”

Il y a également un InnerEye, une application qui utilise le machine learning pour aider les médecins à constituer plus rapidement des images 3D d’organes. Celles-ci sont utilisées dans le traitement du cancer, afin de diriger plus précisément les rayons sur les cellules cancéreuses. En effet, il faut souvent plusieurs heures au médecin pour indiquer le positionnement approximatif de la vessie sur chaque photo d’une IRM. Un logiciel de traitement d’images et le machine learning devraient accélérer grandement ce processus.

La langue naturelle

Outre l’IA pour la reconnaissance d’images et le machine learning, Microsoft investit aussi lourdement dans le traitement de la langue naturelle. “Nous travaillons depuis des années à la machine translation, c’est-à-dire la traduction automatique de la langue naturelle”, explique Harry Shum. “Notre objectif a toujours été de pouvoir traduire en temps réel une conversation entre deux personnes. Selon moi, nous y sommes d’ailleurs parvenus. Il existe à présent Skype Translator, permettant de traduire en temps réel des conversations Skype et cela fonctionne bien.” Le même code logiciel est désormais également disponible sous forme d’API sous le nom de Microsoft Translator. Dans la lignée de ces évolutions, l’entreprise présente également son dernier produit de la gamme : un plug-in de traduction pour PowerPoint, déjà téléchargeable. “Cet outil fournit une traduction en temps réel en différentes langues lorsque vous donnez une présentation”, explique Marcel Tilly, program manager du département AI & Research de Microsoft. Le logiciel reconnaît ce que raconte l’orateur (par le biais d’un casque-micro) et ajoute des sous-titres. “Nous avons entraîné ce modèle de reconnaissance, afin qu’il place également les sous-titres corrects lorsque les orateurs utilisent des dialectes ou ont des accents”, ajoute-t-il. Marcel Tilly, très clairement allemand, fait ensuite une démo en anglais pour montrer le fonctionnement. “Même si je me trompe dans le nom d’un village français, par exemple, vous constaterez que les sous-titres sont corrects”, explique-t-il. Dans un second temps, une traduction sera ajoutée à ces sous-titres. Cette fonctionnalité combinée au précité Microsoft Translator vous permet de suivre une présentation sous-titrée dans votre propre langue.

Sauver le monde

Si vous n’avez pas encore clairement compris que Microsoft désirait sauver le monde au moyen de l’IA, découvrez “AI for Earth”, un ensemble d’outils conçus pour aider les gens qui s’occupent du changement climatique. “Nous souhaitons véritablement concevoir des applications positives pour la société”, explique Eric Horvitz, technical fellow et managing director de Microsoft Research. “Nous utilisons de volumineux fichiers de données pour aider les populations des pays en développement, mais également les pays développés.” Il avance l’exemple d’une carte des vents et de la météo développée par Microsoft sur la base de données ouvertes de stations météorologiques. Celle-ci est actuellement utilisée par plusieurs compagnies aériennes pour développer de meilleurs itinéraires de vol.

Afin de pouvoir développer plus rapidement cette application et d’autres, l’entreprise a désormais créé Microsoft Research AI, un incubateur pour l’intelligence artificielle. Son objectif vise notamment à constituer une plus grande “intelligence générale” pour l’IA, selon Eric Horvitz. “Différentes IA présentent chacune leurs compétences et leur spécialisation. Nous souhaitons les réunir au sein d’une IA qui comprend les gens, qui connaît nos angles morts, nos préjugés, les lacunes de notre mémoire, et qui peut les compenser spécifiquement.”

Qui a peur de l’IA ?

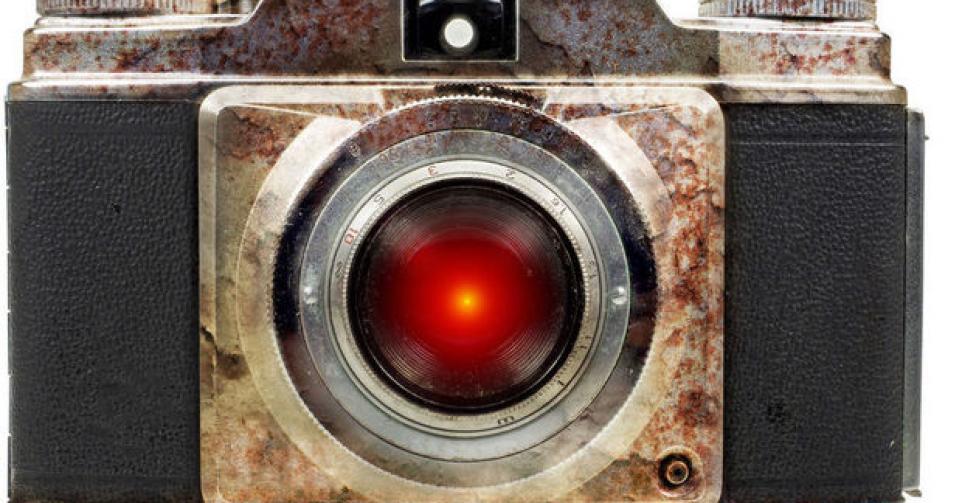

Des projets si complets pour l’IA entraînent inévitablement une discussion éthique. “Nous voulons, bien sûr, éviter une situation telle que dans 2001, l’Odyssée de l’espace“, déclare Harry Shum. Dans ce classique du cinéma, une intelligence artificielle baptisée HAL 9000 s’empare de sa propre initiative d’une station spatiale, que son habitant soit d’accord ou non. Il s’agit probablement de l’exemple le plus connu de notre “peur de l’IA”, la crainte de perdre le contrôle. “On voit bien qu’il existe une certaine peur”, admet Emma Williams, general manager AI Products Design. “Une crainte biologique d’une nouvelle race dominante. C’est pourquoi nous nous tenons à quelques principes solides lorsque nous développons une IA. Les hommes restent les héros et restent au centre.”

“Il est important d’intégrer dès le début l’aspect éthique à l’IA”, affirme encore Harry Shum. “Nous ne pouvons pas y parvenir seuls. C’est pourquoi nous avons lancé un partenariat autour de l’IA, une association sans but lucratif visant à partager les meilleures pratiques relatives à la technologie IA.” Le groupe, dont font également partie IBM, Google, Facebook et Amazon, a été baptisé du nom légèrement propagandiste Partnership on Artificial Intelligence to Benefit People and Society et doit notamment aider les gens à se défaire de leur crainte de l’IA. Un organe de conseil éthique serait également en cours de création (l’Aether Advisory Panel ou panel AI and Ethics in Engineering and Research), qui devrait veiller au grain.

Préjugés et responsabilité

Reste à savoir comment ils régleront cette question éthique, maintenant que plusieurs exemples successifs ont montré que l’IA n’était pas toujours aussi objective. L’IA a tendance, par exemple, à reprendre, consciemment ou non, des préjugés des personnes ayant participé à son développement. Ce problème est souvent lié aux fichiers de données sur lesquels l’IA s’est entraînée. “Nous avons évolué vers un nouveau type de logiciels”, déclare Chris Bishop, technical fellow et responsable du Research lab de Microsoft à Cambridge. “Avant, nous écrivions manuellement le logiciel et indiquions chaque fois ce que le programme devait pouvoir faire. À présent, nous écrivons un logiciel capable d’apprendre et que nous allons entraîner.” Ensuite, lorsque ce logiciel doit prendre des décisions importantes, par exemple dans les soins de santé, il doit bien sûr pouvoir le faire correctement. Chris Bishop parle de responsabilité du technologue. “Tout dépend bien sûr des fichiers de données”, déclare-t-il. “Parfois, on constate qu’ils contiennent des préjugés considérés par la société comme inappropriés. Dans pareil cas, nous les enlevons.”

“Des préjugés inhérents peuvent être résolus par l’utilisation de fichiers de données plus grands”, explique Eric Horvitz. “Néanmoins, la transparence constitue parfois déjà une première étape importante. Il y a quelque temps, nous avions, par exemple, développé la reconnaissance faciale, qui s’est avérée ne pas fonctionner sur les enfants. Nous nous sommes donc rendus au laboratoire et avons demandé le fichier de données, qui s’est avéré contenir principalement des adultes.” Pour pallier ce problème, poursuit Eric Horvitz, il est possible d’adapter le fichier de données ou d’utiliser un disclaimer : “Attention : ne pas utiliser sur les enfants de moins de 12 ans.” Pour Eric Horvitz, plusieurs des problèmes typiques de l’IA pourraient bien être simplement résolus par l’utilisation d’une plus grande quantité d’informations. “Prenons, par exemple, les voitures autonomes et le dilemme du tramway (dans le cadre duquel la voiture autonome doit choisir, par exemple, entre percuter un enfant ou trois adultes, ndlr.). Il s’agit d’un important problème pour l’IA éthique, sur lequel travaillent de nombreuses personnes. On peut éventuellement imaginer informer les gens. Au lieu d’une seule configuration qui donnerait toujours priorité aux passagers au détriment du cerf qui traverse, on pourrait prévoir un vaste tutoriel et une série de problèmes pour lesquels le chauffeur paramétrerait lui-même l’IA.” La voiture du futur, telle que nous nous l’imaginons, vous permet non seulement d’affiner les basses de vos baffles, mais également l’importance que vous accordez aux piétons.

Il s’agit d’une possibilité passionnante, qui ne facilitera pas le combat judiciaire qui consistera à savoir “qui est responsable” lorsque, pour la première fois, une voiture autonome fauchera quelqu’un. Le fait que Microsoft ait conscience que tout le monde n’est pas aussi optimiste quant à l’avenir avec l’IA que l’entreprise elle-même donne néanmoins une lueur d’espoir. “Hollywood n’aide pas à rassurer les gens”, rit Marc Bishop. Mais on y travaille. Même lorsqu’il s’agit, par exemple, de préjugés inhérents. “Nous utilisons beaucoup le feed-back de la communauté”, affirme Marc Bishop. “Nous travaillons notamment avec le Royal Institute (une organisation britannique qui s’occupe d’études scientifiques et de l’enseignement), afin de tester ce sur quoi nous travaillons. C’est également crucial. En effet, en tant que technologue, je souhaite développer l’IA la plus puissante possible. Mais en tant que citoyen, je n’ai peut-être pas envie que tout soit décidé par une IA.”