D’une enquête à laquelle a participé l’UGent, il apparaît que les décisions prises par les enfants peuvent être influencées non seulement par d’autres enfants, mais aussi par des robots.

‘Si des amis te demandaient de te jeter à l’eau, le ferais-tu?’, demandent parfois des parents, lorsqu’ils observent que leur enfant pâtit d’une certaine pression sociale. Peut-être vont-ils bientôt devoir lui poser une nouvelle question: ‘Si un robot te demandait de te jeter à l’eau, le ferais-tu?’ D’une nouvelle étude, il ressort en effet que les avis et les décisions des enfants sont aussi influencés par ce que des robots leur disent.

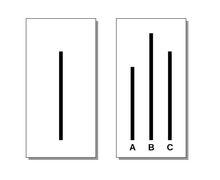

Solomon Asch, un pionnier en psychologie sociale, avait dans les années 50 du siècle dernier déjà examiné dans quelle mesure les gens sont influencés par la pression sociale. Il effectua ainsi une expérience, par laquelle un sujet voyait apparaître quatre lignes sur un écran et devait indiquer les deux lignes de même longueur.

Lorsque les sujets passaient ce test individuellement, ils commettaient rarement une erreur, mais quand six autres personnes y participaient, qui donnaient (sciemment) une réponse erronée, les sujets étaient alors davantage enclins à suivre les autres. La pression sociale peut donc faire en sorte qu’une personne dise ou fasse des choses incorrectes.

Pour savoir si des robots peuvent aussi exercer ce genre d’influence sociale sur les gens, des chercheurs ont répété ce test plus de soixante ans après. Ils ont procédé de trois manières différentes: avec un sujet seul dans le local de test, avec un sujet et d’autres personnes de son âge, et enfin avec des robots sociaux dans le local de test.

Alors que les adultes adaptent souvent leur avis sur base de ce que disent les autres (‘conformisation’), il est apparu qu’ils résistent en général à l’influence des robots. Il en va autrement chez les enfants. Les enfants (de 7 à 9 ans) qui ont participé à l’expérience, donnèrent souvent les mêmes réponses que le robot et ce, même si ces réponses étaient clairement fautives.

Les enfants qui ont passé le test seuls, ont obtenu le score moyen de 87 pour cent de bonnes réponses. Mais lorsqu’ils ont effectué le test conjointement avec un robot, le score est retombé à 75 pour cent. Lorsqu’ils donnèrent une réponse erronée, c’était sous l’influence du robot dans 74 pour cent des cas.

L’expérience était dirigée par Anna Vollmer (université de Bielefeld en Allemagne) et par Tony Belpaeme (UGent et université de Plymouth). Les résultats sont parus mercredi dans la revue spécialisée Science Robotics.

Questions éthiques

Que se passerait-il si des robots faisaient des suggestions en matière de comportement d’achat ou sur ce que vous devez penser?

L’expérience propose une vision des chances/risques et de l’attention à accorder à la façon dont les robots peuvent être utilisés dans la société. L’apprentissage à la conformisation peut être favorable sur certains plans, mais le risque d’abus et l’impact possible d’une utilisation incorrecte suscitent des questions éthiques.

“Nous savons depuis longtemps déjà qu’il est malaisé de ne pas se laisser influencer par des prises de position et des opinions de personnes de notre entourage. Mais comme les robots feront bientôt partie de notre vie de tous les jours et de notre lieu de travail, il faut se demander si et comment les humains vont s’adapter à leur présence”, déclare Tony Belpaeme, professeur de robotique.

“Ce que nos expériences démontrent, c’est que les adultes n’adaptent pas leur avis aux dires des robots, alors que les enfants semblent le faire. Ces derniers ont peut-être plus d’affinité avec les robots que les adultes. L’étude fait surgir la question suivante: que se passerait-il si des robots faisaient des suggestions en matière de comportement d’achat ou sur ce que vous devez penser?”

“Un avenir dans lequel des robots sociaux autonomes seront utilisés pour assister des professionnels de l’enseignement ou des pédiatres, n’est plus très loin. Dans ce genre d’applications, le robot occupera une position, dans laquelle l’information donnée pourra avoir une influence substantielle sur les personnes avec qui il communiquera.”

Selon Belpaeme, il faut approfondir le débat: “Ne conviendrait-il pas de prendre des mesures de protection comme un cadre réglementaire, en vue de minimiser les risques pour les enfants lors d’interactions sociales avec les robots? Et quelle forme devrait prendre cette éventuelle réglementation, afin de pas impacter négativement les développements prometteurs dans ce domaine?”