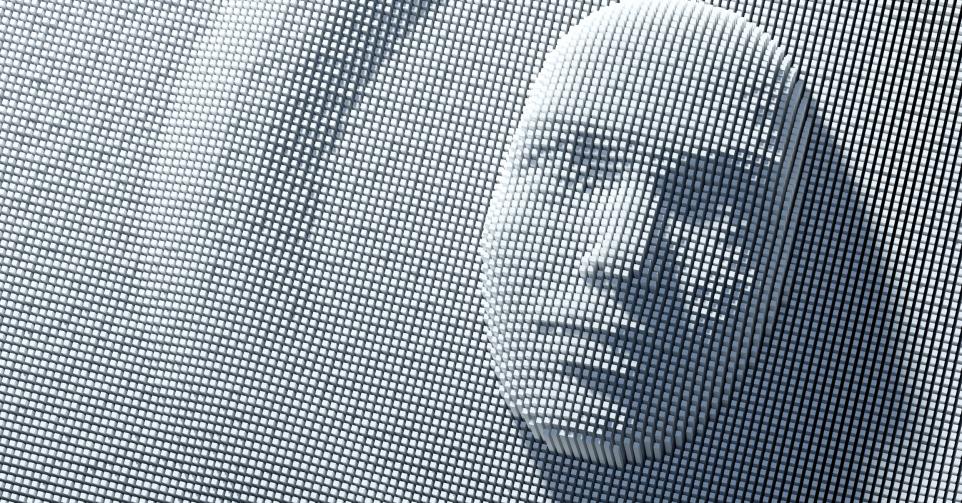

L’analyste de marché Gartner prévient que l’identification basée sur le visage finira par ne plus être fiable. L’évolution des deepfakes (hyper-trucages) permettra en effet de se faire passer pour n’importe qui.

Les vidéos deepfake sont des images dans lesquelles le visage d’une personne est copié à l’aide de l’IA. Sous une forme rudimentaire, l’opération est relativement facile à faire aujourd’hui dans une appli web. Mais quiconque possède le temps et l’expertise voulus, est capable de générer des images qui ne peuvent plus être distinguées de la réalité à l’œil nu, même sur un ordinateur de jeu ordinaire équipé d’une carte vidéo moyenne moderne.

Le Belge Chris Umé avait fait sensation, il y a quelques années, en faisant apparaître un Tom Cruise généré par l’IA dans des vidéos très nettes, impossibles à distinguer du vrai Cruise.

Vous pouvez modifier vos choix à tout moment en cliquant sur « Paramètres des cookies » en bas du site.

Gartner affirme désormais que cette technologie commence également à présenter des risques en matière de sécurité. ‘Au cours des dix dernières années, plusieurs jalons ont été franchis dans le domaine de l’IA, ce qui permet de créer des images de synthèse. Ces images générées artificiellement de personnes réelles, également connues sous le nom de deepfakes, peuvent être utilisées pour saper ou rendre inefficace l’authentification biométrique’, déclare Akif Khan, VP Analyst chez Gartner.

‘Cela pourrait amener des organisations à douter de la fiabilité des solutions de contrôle d’identité et d’authentification, car elles ne pourraient pas garantir que le visage d’une personne est réel ou bien s’il s’agit d’un deepfake’, ajoute Khan. Gartner prévoit que d’ici 2026, trente pour cent des entreprises ne feront plus confiance au contrôle d’identité basé sur la biométrie (faciale).

L’analyste constate que le contrôle biométrique actuel vérifie, entre autres, la vivacité d’un visage. Dans le passé, par exemple, il était possible de tromper ce genre de scan avec une bonne photo pour une webcam, alors qu’aujourd’hui, un tel scan s’effectue plus souvent sur la base du mouvement, de la profondeur, de la perspective, etc. Mais selon Gartner, les processus et normes actuels ne prennent pas en compte une injection de deepfakes. Il conseille donc aux entreprises de choisir pour ce type de contrôle un acteur capable de démontrer que cela va au-delà des normes en vigueur